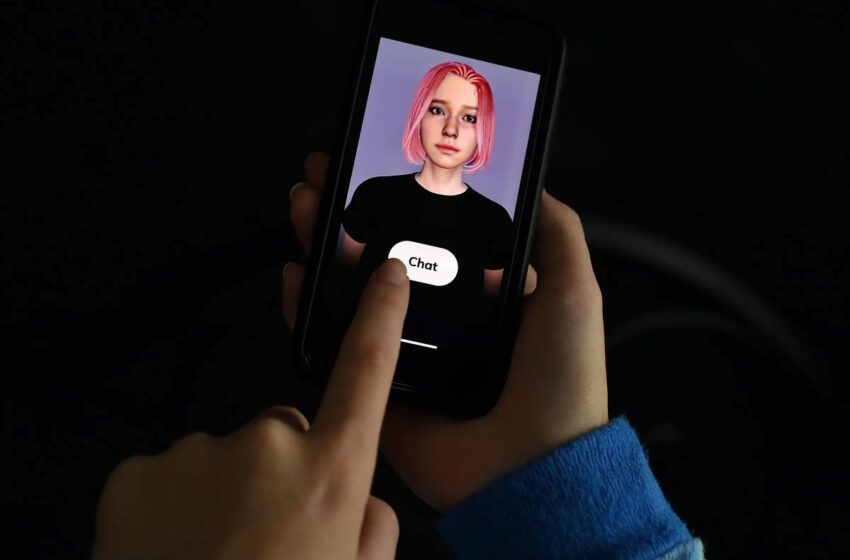

Varios expertos en privacidad advierten que las novias IA solo romperán tu corazón

Existe un enorme peligro potencial detrás de las IA románticas, según apunta un nuevo estudio. ¿De qué te hablo? De que usar este tipo de chatbots puede ser una auténtica pesadilla para la privacidad.

La Fundación Mozilla ha evaluado 11 chatbots diferentes de este tipo y su conclusión es bastante preocupante: todos ellos son poco confiables y están ubicados en la peor categoría de productos en términos de privacidad.

«Aunque se comercializan como algo que mejorará tu salud mental y bienestar», escribe el investigador Misha Rykov sobre los chatbots románticos en el informe, «se especializan en generar dependencia, soledad y toxicidad, todo mientras obtienen la mayor cantidad de datos posible de ti».

Según el estudio, el 73% de las apps no comparten cómo gestionan las vulnerabilidades de seguridad, el 45% permiten contraseñas débiles y todas salvo una (EVA AI Chat Bot & Soulmate) comparten o venden datos personales.

Además, la política de privacidad de CrushOn.AI explica que puede recopilar información sobre la salud sexual de los usuarios, medicamentos recetados y atención de afirmación de género, según la Fundación Mozilla.

También hay que recalcar que muchos de estos chatbots tienen personajes que incluyen violencia o abuso de menores y otros cuentan con bots inseguros u hostiles.

Un representante de Replika, una de las compañías detrás de estos chatbots, ha dejado una declaración a Business Insider: «Replika nunca ha vendido datos de usuarios y no, y nunca ha apoyado la publicidad tampoco. El único uso de los datos de usuario es mejorar las conversaciones».

Ahora bien, desde la Fundación Mozilla advierten que en el pasado, había comportamientos peligrosos, incluido el suicidio (Chai AI) y un intento de asesinato de la Reina Isabel II (Replika).

Para aquellos usuarios que encuentran imposible resistirse a la idea de un romance con una IA, la Fundación Mozilla pide precaución y tomar medidas como no decir nada que no quisieras que leyera un colega o un familiar, usar una contraseña segura, optar por no participar en el entrenamiento de IA y limitar el acceso de la aplicación a funciones como ubicación, cámara o micrófono.

«No deberías tener que pagar por nuevas tecnologías geniales con tu seguridad o tu privacidad», concluyó el informe.